안녕하세요, AI 기술의 무한한 가능성에 매료된 여러분! 최근 인공지능 분야에서 가장 뜨거운 키워드 중 하나는 바로 ‘로컬 LLM(Large Language Model)’입니다. 클라우드 기반의 거대 AI 모델들이 주류를 이루는 가운데, 내 컴퓨터에서 직접 LLM을 돌릴 수 있다는 사실은 많은 개발자와 AI 애호가들에게 엄청난 자유와 가능성을 선사하고 있죠. 그리고 이 모든 것을 가능하게 하는 마법 같은 도구가 바로 Ollama입니다. 오늘은 이 Ollama 사용법에 대해 A부터 Z까지, 그리고 어떤 LLM 모델들을 활용하면 좋을지 쉽고 재미있게 파헤쳐 보겠습니다.

클라우드 기반 LLM은 편리하지만, 민감한 데이터를 다루거나 비용 문제, 혹은 인터넷 연결 없이 사용해야 할 때는 한계가 명확합니다. 하지만 Ollama 사용법을 익히면 이런 고민들을 한 방에 날려버릴 수 있습니다. 개인 정보 유출 걱정 없이 나만의 AI 비서와 대화하고, 인터넷이 끊겨도 든든하게 작업을 이어갈 수 있으며, 심지어 특정 목적에 맞게 모델을 커스터마이징하는 재미까지 누릴 수 있죠. 마치 나만의 슈퍼컴퓨터를 손에 넣는 것과 같은 짜릿한 경험이 될 거예요.

이 글을 통해 여러분은 Ollama 사용법의 기본기를 탄탄히 다지고, 수많은 LLM 모델 중에서 나에게 딱 맞는 보석 같은 모델을 찾아낼 수 있을 겁니다. 복잡하고 어렵게만 느껴졌던 로컬 AI의 세계, 지금부터 저와 함께 쉽고 즐겁게 탐험해 볼까요?

Ollama, 왜 지금 주목해야 할까요? 로컬 LLM의 혁명적인 Ollama 사용법

본격적인 Ollama 사용법을 알아보기 전에, 왜 Ollama가 이렇게 뜨거운 관심을 받고 있는지 그 배경부터 이해하는 것이 중요합니다. 단순히 ‘내 컴퓨터에서 AI를 돌린다’는 것을 넘어, Ollama는 로컬 LLM 시대를 가속화하는 핵심적인 역할을 하고 있거든요.

1. 개인 정보 보호와 보안 강화: 나만의 AI 비서

클라우드 기반 LLM을 사용할 때 가장 큰 우려 중 하나는 바로 개인 정보 유출입니다. 민감한 업무 자료나 개인적인 질문을 AI에 입력할 때마다 ‘내 데이터가 어딘가에 저장되거나 분석되는 건 아닐까?’ 하는 불안감을 떨치기 어렵죠. 하지만 Ollama 사용법을 통해 로컬에서 LLM을 구동하면, 모든 데이터 처리가 내 컴퓨터 안에서 이루어집니다. 외부 서버로 정보가 전송될 일이 없으니, 개인 정보 보호와 보안 측면에서 압도적인 이점을 가집니다. 기업이나 연구 기관에서 기밀 데이터를 다룰 때 특히 빛을 발하는 부분이죠.

2. 비용 절감 및 무제한 활용: 똑똑한 경제성

대부분의 클라우드 LLM 서비스는 사용량에 따라 비용을 청구합니다. API 호출 횟수, 토큰 사용량 등에 비례하여 요금이 부과되죠. AI를 많이 활용하는 사용자나 개발자에게는 이 비용이 만만치 않을 수 있습니다. 하지만 Ollama 사용법을 익혀 로컬에서 LLM을 돌리면, 초기 하드웨어 투자 비용 외에는 추가적인 사용료가 발생하지 않습니다. 한 번 설치하면 무제한으로, 원하는 만큼 AI를 활용할 수 있다는 것이죠. 이는 장기적으로 엄청난 비용 절감 효과를 가져다줍니다.

3. 인터넷 연결 없이 언제 어디서나: 진정한 자유

해외 출장 중이거나, 인터넷 연결이 불안정한 환경에서도 AI의 도움이 필요할 때가 있습니다. 클라우드 LLM은 인터넷 연결이 필수적이지만, Ollama 사용법을 통해 로컬에 설치된 LLM은 인터넷 연결 여부와 상관없이 항상 준비되어 있습니다. 비행기 안에서, 혹은 네트워크가 끊긴 오지에서도 나만의 AI 비서와 함께 작업을 이어갈 수 있다는 것은 상상 이상의 편리함을 제공합니다.

4. 맞춤형 활용과 개발의 용이성: 나만의 AI 창조

Ollama는 단순히 LLM을 실행하는 것을 넘어, Modelfile이라는 기능을 통해 사용자가 직접 모델을 커스터마이징하고 새로운 모델을 만들 수 있도록 지원합니다. 특정 데이터셋으로 파인튜닝하거나, 특정 작업에 최적화된 프롬프트를 내장하는 등, 나만의 AI를 창조하는 것이 가능해지는 것이죠. 이는 개발자들에게 무한한 실험과 혁신의 기회를 제공합니다. Ollama 사용법의 진정한 매력은 바로 여기에 있습니다.

이러한 장점들 덕분에 Ollama는 로컬 LLM 생태계의 핵심 도구로 빠르게 자리매김하고 있습니다. 이제 이 강력한 도구를 어떻게 사용할 수 있는지, 그 구체적인 Ollama 사용법에 대해 자세히 알아보겠습니다.

Ollama 사용법: 설치부터 실행까지, 초보자도 쉽게!

자, 이제 이론은 충분합니다! 직접 Ollama 사용법을 익혀 로컬 LLM의 세계로 뛰어들 시간입니다. 걱정 마세요, Ollama는 놀랍도록 설치와 사용이 간편합니다. 마치 스마트폰 앱을 설치하는 것만큼이나 쉽다고 할 수 있죠.

1. Ollama 설치하기: 운영체제별 가이드

Ollama는 macOS, Windows, Linux 등 다양한 운영체제를 지원합니다. 여러분의 환경에 맞춰 설치를 진행해 보세요.

1.1. 공식 웹사이트 방문

가장 먼저, Ollama 공식 웹사이트(ollama.com)에 접속합니다. 웹사이트에 접속하면 운영체제별 다운로드 링크가 명확하게 보일 거예요.

1.2. macOS 설치

macOS 사용자는 ‘Download for macOS’ 버튼을 클릭하여 `.dmg` 파일을 다운로드합니다. 다운로드된 파일을 열고, Ollama 아이콘을 애플리케이션 폴더로 드래그 앤 드롭하면 설치가 완료됩니다. 간단하죠? 설치 후 애플리케이션 폴더에서 Ollama를 실행하면 메뉴바에 Ollama 아이콘이 나타나며 백그라운드에서 서비스가 시작됩니다.

1.3. Windows 설치

Windows 사용자는 ‘Download for Windows’ 버튼을 클릭하여 `.exe` 설치 파일을 다운로드합니다. 다운로드된 파일을 실행하고, 일반적인 Windows 프로그램 설치 과정과 동일하게 ‘Next’ 버튼을 눌러 설치를 완료합니다. 설치가 완료되면 Ollama가 자동으로 시작되며, 트레이 아이콘으로 표시될 것입니다.

1.4. Linux 설치

Linux 사용자는 터미널을 열고 다음 명령어를 입력하여 설치할 수 있습니다. 스크립트가 자동으로 Ollama를 다운로드하고 설치해 줄 거예요.

curl -fsSL https://ollama.com/install.sh | sh설치가 완료되면 Ollama 서비스가 자동으로 시작됩니다.

2. 첫 LLM 모델 다운로드 및 실행: Ollama 사용법의 핵심!

Ollama 설치를 마쳤다면, 이제 가장 중요한 단계인 LLM 모델을 다운로드하고 실행할 차례입니다. Ollama는 다양한 LLM 모델을 지원하며, 이 모델들은 마치 앱스토어에서 앱을 다운로드하듯이 쉽게 설치할 수 있습니다.

2.1. 모델 다운로드 및 실행

터미널(macOS/Linux) 또는 명령 프롬프트/PowerShell(Windows)을 열고 다음 명령어를 입력해 보세요. 여기서는 가장 인기 있는 모델 중 하나인 Llama 2를 예시로 들겠습니다.

ollama run llama2이 명령어를 입력하면 Ollama가 자동으로 Llama 2 모델을 다운로드하기 시작합니다. 모델의 크기에 따라 다운로드 시간이 다소 소요될 수 있습니다. (보통 수 GB에 달합니다!) 다운로드가 완료되면, 즉시 Llama 2와 대화할 수 있는 프롬프트가 나타날 거예요.

>>> Send a message (/? for help)이제 여기에 질문을 입력하고 엔터를 누르면 Llama 2가 답변을 생성하기 시작합니다. 마치 ChatGPT를 사용하는 것과 같은 경험을 로컬에서 할 수 있습니다. 대화를 마치려면 `/bye`를 입력하고 엔터를 누르면 됩니다.

2.2. 설치된 모델 확인

현재 내 컴퓨터에 어떤 LLM 모델들이 설치되어 있는지 확인하고 싶다면 다음 명령어를 사용합니다.

ollama list이 명령어는 설치된 모델들의 목록과 각 모델의 크기, 마지막 사용 시간 등을 보여줍니다.

2.3. 모델 삭제

더 이상 사용하지 않는 모델이 있다면 다음 명령어로 삭제하여 디스크 공간을 확보할 수 있습니다.

ollama rm llama2(여기서 `llama2`는 삭제하려는 모델의 이름입니다.)

3. Ollama Web UI 활용: 더 편리한 Ollama 사용법

터미널에서 명령어를 입력하는 것이 익숙하지 않거나, 좀 더 시각적이고 편리한 인터페이스를 선호한다면 Ollama를 위한 웹 UI를 사용하는 것을 강력히 추천합니다. 대표적인 웹 UI로는 ‘Open WebUI’가 있습니다. 이를 사용하면 ChatGPT처럼 웹 브라우저에서 편하게 LLM과 대화하고, 모델을 관리할 수 있습니다.

3.1. Open WebUI 설치 (Docker 필요)

Open WebUI는 Docker 컨테이너로 실행하는 것이 가장 일반적이고 권장되는 방법입니다. 따라서 먼저 Docker Desktop을 설치해야 합니다. Docker 설치 후, 다음 명령어를 터미널에 입력하여 Open WebUI를 실행할 수 있습니다.

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main이 명령어를 실행하면 Open WebUI 컨테이너가 백그라운드에서 시작됩니다. 잠시 기다린 후 웹 브라우저를 열고 `http://localhost:3000`으로 접속하면 Open WebUI 화면을 만날 수 있습니다. 최초 접속 시 사용자 계정을 생성해야 합니다.

3.2. Open WebUI 기능 소개

- 직관적인 채팅 인터페이스: ChatGPT와 유사한 인터페이스로 LLM과 자연스럽게 대화할 수 있습니다.

- 모델 관리: 설치된 Ollama 모델 목록을 확인하고, 새로운 모델을 검색하여 다운로드하거나 삭제하는 등의 작업을 웹 UI에서 직접 수행할 수 있습니다.

- 프롬프트 저장 및 관리: 자주 사용하는 프롬프트를 저장하고 관리하여 효율적으로 LLM을 활용할 수 있습니다.

- 다양한 설정: 모델 파라미터(온도, 토큰 길이 등)를 조절하여 LLM의 응답 방식을 세밀하게 제어할 수 있습니다.

Open WebUI를 활용하면 Ollama 사용법이 훨씬 더 편리하고 즐거워질 것입니다. 마치 나만의 ChatGPT를 구축한 것 같은 느낌을 받을 수 있죠.

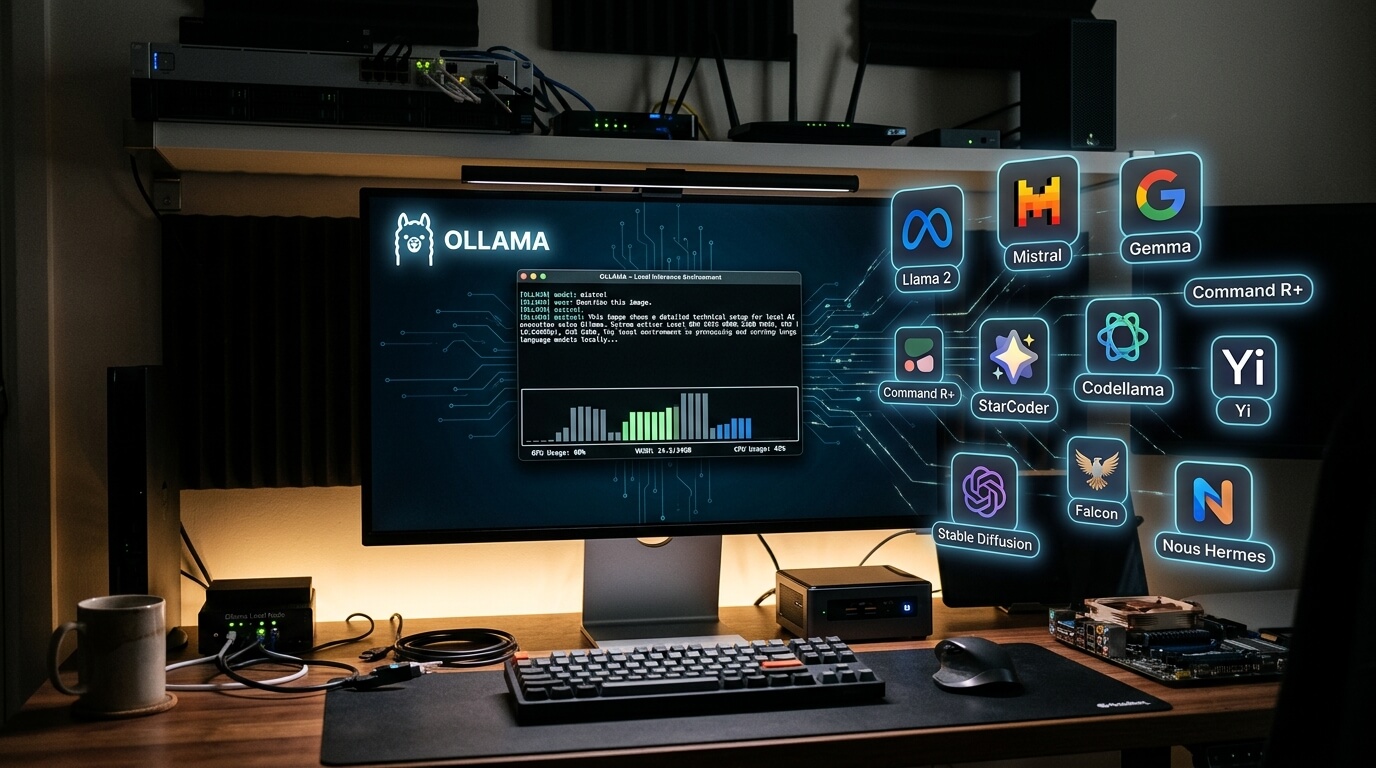

대표 LLM 모델, Ollama 사용법과 함께 알아볼까요?

Ollama의 가장 큰 장점 중 하나는 다양한 LLM 모델을 쉽게 사용할 수 있다는 것입니다. 하지만 너무 많은 모델이 있어서 어떤 것을 선택해야 할지 막막할 때가 있죠. 걱정 마세요! 지금부터 Ollama에서 인기 있고 유용한 대표 LLM 모델들의 특징과 추천 용도를 자세히 설명해 드릴게요. 여러분의 Ollama 사용법 경험을 더욱 풍부하게 만들어 줄 모델들을 만나보세요.

LLM 모델의 종류와 특징 이해하기

LLM 모델은 ‘매개변수(Parameter)’의 수, 학습 데이터의 양, 그리고 아키텍처에 따라 성능과 특성이 달라집니다. 일반적으로 매개변수가 많을수록 더 복잡한 추론과 풍부한 답변을 생성할 수 있지만, 그만큼 더 많은 컴퓨팅 자원(특히 GPU 메모리)을 요구합니다. Ollama에서는 다양한 크기의 모델(예: 7B, 13B, 70B 등, B는 Billion 즉 10억을 의미)을 제공하므로, 여러분의 하드웨어 사양에 맞춰 적절한 모델을 선택하는 것이 중요합니다.

주요 Ollama 호환 LLM 모델 소개

1. Llama 2 (Meta)

- 특징: Meta에서 개발한 오픈소스 LLM의 대표 주자입니다. 7B, 13B, 70B 등 다양한 크기로 제공되며, 광범위한 데이터로 학습되어 범용성이 뛰어납니다. 특히 영어 기반의 텍스트 생성, 요약, 질문 답변 등 다양한 작업에서 준수한 성능을 보여줍니다.

- 장점: 오픈소스 생태계가 활발하여 관련 자료와 커뮤니티 지원이 풍부합니다. 안정적이고 신뢰할 수 있는 성능을 제공하며, 상업적 이용도 가능합니다 (특정 조건 하에).

- 단점: 한국어 성능은 다른 한국어 특화 모델에 비해 다소 아쉬울 수 있습니다. 큰 모델은 상당한 GPU 자원을 요구합니다.

- 추천 용도: 로컬 LLM 입문자, 영어 기반의 일반적인 질문 답변, 텍스트 생성, 코드 생성 보조, 개인 학습 및 연구.

- Ollama 사용법:

ollama run llama2

2. Mistral (Mistral AI)

- 특징: 프랑스의 AI 스타트업 Mistral AI에서 개발한 모델로, 비교적 작은 매개변수(예: 7B)에도 불구하고 Llama 2 13B 모델에 필적하거나 능가하는 뛰어난 성능을 보여줍니다. 효율성과 속도에 강점을 가지고 있어 저사양 기기에서도 비교적 원활하게 작동합니다.

- 장점: 작은 크기 대비 높은 성능, 빠른 추론 속도, 효율적인 자원 사용. 특히 코딩 관련 작업에서 좋은 평가를 받습니다.

- 단점: Llama 2만큼 광범위한 커뮤니티는 아직 아니며, 특정 분야에서는 더 큰 모델에 비해 깊이가 부족할 수 있습니다.

- 추천 용도: 제한된 하드웨어 자원을 가진 사용자, 빠른 응답 속도가 필요한 애플리케이션, 코딩 보조, 텍스트 요약 및 생성.

- Ollama 사용법:

ollama run mistral

3. Gemma (Google)

- 특징: Google DeepMind에서 개발한 경량 오픈 모델 시리즈입니다. Gemini 모델의 기술을 기반으로 하며, 안전성과 책임 있는 AI 개발에 중점을 둡니다. 2B, 7B 등 비교적 작은 크기로 제공되어 접근성이 좋습니다.

- 장점: Google의 최신 기술이 적용되어 뛰어난 성능을 보이며, 안전하고 윤리적인 AI 사용을 지향합니다. 경량 모델이므로 저사양 기기에서도 활용하기 좋습니다.

- 단점: 아직 초기 단계이므로 커뮤니티 지원이나 활용 사례가 다른 모델에 비해 적을 수 있습니다.

- 추천 용도: 개인 학습, 실험, 안전한 AI 응용 프로그램 개발, 경량 AI 모델 활용.

- Ollama 사용법:

ollama run gemma

4. Phi-3 (Microsoft)

- 특징: Microsoft에서 개발한 소형 언어 모델(SLM) 시리즈입니다. 특히 Phi-3-mini는 3.8B 매개변수를 가지고도 GPT-3.5에 준하는 추론 능력을 보여주며, 스마트폰이나 엣지 디바이스와 같은 저사양 환경에 최적화되어 있습니다.

- 장점: 놀라운 효율성과 추론 능력, 매우 작은 크기로 인해 거의 모든 기기에서 실행 가능합니다.

- 단점: 아직 매우 새로운 모델이므로, 광범위한 검증이나 커뮤니티 자료가 부족할 수 있습니다.

- 추천 용도: 엣지 디바이스 AI, 모바일 AI 애플리케이션 개발, 매우 제한된 자원 환경에서의 AI 활용, 간단한 추론 및 텍스트 생성.

- Ollama 사용법:

ollama run phi3

5. Qwen (Alibaba Cloud)

- 특징: Alibaba Cloud에서 개발한 대규모 언어 모델 시리즈로, 특히 다국어 지원에 강점을 가지고 있습니다. 한국어를 포함한 다양한 언어에서 준수한 성능을 보여줍니다. 0.5B부터 72B까지 다양한 크기로 제공됩니다.

- 장점: 뛰어난 다국어 처리 능력, 특히 아시아권 언어에 강점을 가집니다. 다양한 크기로 제공되어 하드웨어 사양에 맞춰 선택의 폭이 넓습니다.

- 단점: 다른 서구권 모델에 비해 상대적으로 덜 알려져 있어 정보 접근성이 떨어질 수 있습니다.

- 추천 용도: 다국어 번역 및 생성, 한국어 텍스트 처리, 글로벌 커뮤니케이션 도구, 아시아 시장 대상 AI 서비스 개발.

- Ollama 사용법:

ollama run qwen

6. Code Llama (Meta)

- 특징: Llama 2를 기반으로 코드 생성 및 분석에 특화된 모델입니다. 다양한 프로그래밍 언어에 대한 이해도가 높아 개발자들에게 유용합니다.

- 장점: 코드 자동 완성, 코드 디버깅, 코드 설명, 특정 언어의 코드 생성 등 개발 생산성 향상에 크게 기여합니다.

- 단점: 텍스트 생성 등 일반적인 LLM 작업에는 Llama 2 기본 모델이 더 적합할 수 있습니다.

- 추천 용도: 소프트웨어 개발, 프로그래밍 학습, 코드 리뷰 보조, 스크립트 작성.

- Ollama 사용법:

ollama run codellama

7. Polyglot-ko (한국어 특화 모델)

- 특징: 한국어에 특화되어 학습된 모델로, 한국어 텍스트 처리에서 뛰어난 성능을 보여줍니다. 한국어의 복잡한 문법과 표현을 잘 이해하고 생성합니다.

- 장점: 한국어 질문 답변, 한국어 텍스트 요약 및 생성, 한국어 기반의 창의적인 글쓰기 등에서 탁월한 결과를 기대할 수 있습니다.

- 단점: 영어 등 다른 언어 처리 능력은 범용 모델에 비해 떨어질 수 있습니다.

- 추천 용도: 한국어 기반의 콘텐츠 생성, 한국어 고객 서비스 챗봇, 한국어 교육 자료 개발, 한국어 문학 창작 보조.

- Ollama 사용법:

ollama run polyglot-ko(Ollama에서 공식적으로 지원하는 모델 목록에 없을 경우, 커뮤니티에서 Modelfile을 찾아 직접 빌드해야 할 수도 있습니다. 하지만 많은 한국어 모델들이 Ollama 포맷으로 변환되어 공유되고 있습니다.)

이 외에도 Ollama는 공식 라이브러리를 통해 수많은 모델을 제공하고 있습니다. 여러분의 필요와 하드웨어 사양에 맞춰 다양한 모델을 시도해보고, 어떤 모델이 가장 잘 맞는지 직접 경험해 보는 것이 중요합니다. 이것이 바로 Ollama 사용법의 진정한 묘미 중 하나입니다!

나에게 딱 맞는 LLM 모델, Ollama 사용법과 함께 찾아보세요!

다양한 LLM 모델들을 살펴보니, 어떤 모델을 선택해야 할지 더 고민될 수도 있겠네요. 하지만 걱정 마세요! 몇 가지 기준만 알면 여러분의 Ollama 사용법 경험을 극대화할 수 있는 최적의 모델을 찾을 수 있습니다.

1. 모델 선택 가이드라인: 하드웨어, 목적, 언어

1.1. 하드웨어 사양 (특히 GPU 메모리)

가장 중요한 고려 사항입니다. LLM 모델은 GPU 메모리(VRAM)를 많이 사용합니다. 일반적으로 7B 모델은 8GB VRAM 이상, 13B 모델은 16GB VRAM 이상, 70B 모델은 48GB VRAM 이상을 권장합니다. 만약 GPU가 없거나 VRAM이 부족하다면, CPU만으로도 실행할 수 있는 작은 모델(예: Phi-3-mini, Gemma 2B)부터 시작하는 것이 좋습니다. 물론 CPU만으로 돌리면 속도는 훨씬 느려집니다.

- 저사양 (8GB VRAM 이하 또는 CPU만): Phi-3-mini, Gemma 2B, Mistral 7B (CPU 전용 모드)

- 중사양 (16GB VRAM): Llama 2 7B/13B, Mistral 7B, Qwen 7B

- 고사양 (24GB VRAM 이상): Llama 2 70B, Qwen 14B/72B (고성능 GPU 필요)

1.2. 사용 목적

어떤 작업을 위해 LLM을 사용할 것인지 명확히 하는 것이 중요합니다.

- 일반적인 대화/질문 답변: Llama 2, Mistral, Gemma

- 코딩 보조: Code Llama, Mistral

- 창의적인 글쓰기/콘텐츠 생성: Llama 2, Mistral, Qwen

- 텍스트 요약/정보 추출: Mistral, Gemma

- 한국어 특화 작업: Polyglot-ko, Qwen (다국어 능력 활용)

- 저사양/엣지 AI: Phi-3-mini, Gemma 2B

1.3. 주요 사용 언어

대부분의 모델은 영어 기반으로 학습되었지만, 다국어 지원이나 특정 언어에 특화된 모델도 있습니다.

- 주로 영어: Llama 2, Mistral, Gemma, Phi-3

- 한국어 포함 다국어: Qwen, Polyglot-ko

2. 성능 비교 팁: 프롬프트 엔지니어링과 벤치마크

모델을 선택했다면, 실제로 사용해보면서 그 성능을 평가하는 것이 중요합니다. 단순히 ‘좋다/나쁘다’를 넘어, 어떻게 하면 더 좋은 결과를 얻을 수 있는지 탐구하는 과정이 바로 Ollama 사용법의 심화 과정입니다.

2.1. 프롬프트 엔지니어링

LLM의 성능은 프롬프트(질문이나 지시)를 어떻게 작성하느냐에 따라 크게 달라집니다. 명확하고 구체적인 지시, 역할 부여, 예시 제공 등 다양한 프롬프트 엔지니어링 기법을 활용하여 모델의 잠재력을 최대한 끌어낼 수 있습니다. 예를 들어, “이메일을 작성해 줘” 보다는 “친한 친구에게 보내는, 주말 계획을 묻는 비공식적인 이메일을 50단어 내외로 작성해 줘”와 같이 구체적으로 요청하는 것이 좋습니다.

2.2. 벤치마크 및 커뮤니티 리뷰

Hugging Face Leaderboard나 다양한 AI 커뮤니티에서 모델들의 벤치마크 점수나 사용자 리뷰를 참고하는 것도 좋은 방법입니다. 다른 사람들이 특정 모델을 어떻게 평가하고 어떤 용도로 사용하는지 살펴보면, 여러분의 선택에 큰 도움이 될 것입니다.

3. Ollama의 Modelfile 활용: 나만의 LLM 만들기

Ollama의 진정한 강력함은 Modelfile을 통해 모델을 커스터마이징할 수 있다는 점입니다. Modelfile은 특정 모델을 기반으로 하여, 시스템 프롬프트, 모델 파라미터, 학습 데이터 등을 조절하여 새로운 모델을 만드는 레시피와 같습니다. 이를 통해 여러분의 특정 요구사항에 완벽하게 맞는 ‘나만의 LLM’을 만들 수 있습니다.

3.1. Modelfile 생성 예시

예를 들어, Llama 2를 기반으로 하는 ‘친절한 한국어 번역가’ 모델을 만들고 싶다면 다음과 같은 Modelfile을 작성할 수 있습니다.

FROM llama2

SYSTEM """

당신은 한국어와 영어 번역에 특화된 친절한 AI 번역가입니다.

사용자의 요청을 정확하게 이해하고, 자연스럽고 유려한 표현으로 번역해 주세요.

특히 한국어의 뉘앙스를 잘 살려 번역하는 데 집중해 주세요.

"""

PARAMETER temperature 0.7

PARAMETER top_k 40

PARAMETER top_p 0.9이 파일을 `korean-translator.Modelfile`로 저장한 후, 다음 명령어로 새로운 모델을 생성합니다.

ollama create korean-translator -f korean-translator.Modelfile이제 ollama run korean-translator 명령어로 여러분만의 번역가 AI를 실행할 수 있습니다. 이처럼 Modelfile은 Ollama 사용법의 무궁무진한 가능성을 열어주는 강력한 도구입니다.

Ollama 사용법의 미래: 로컬 AI의 무한한 가능성

지금까지 Ollama 사용법의 기본적인 내용부터 대표 LLM 모델, 그리고 나에게 맞는 모델을 선택하는 노하우까지 깊이 있게 다뤄봤습니다. 하지만 Ollama의 잠재력은 여기서 끝이 아닙니다. 로컬 AI 시대의 선두 주자로서 Ollama는 앞으로 더욱 다양한 방식으로 우리의 삶과 업무에 스며들 것입니다.

1. Ollama 생태계의 확장: API 연동과 개발자 활용

Ollama는 단순히 터미널에서 대화하는 것을 넘어, 강력한 REST API를 제공합니다. 이는 개발자들이 자신의 애플리케이션에 Ollama 기반의 LLM 기능을 쉽게 통합할 수 있다는 의미입니다. Python, JavaScript 등 다양한 프로그래밍 언어로 Ollama API를 호출하여 다음과 같은 작업을 수행할 수 있습니다.

- 커스텀 챗봇 개발: 나만의 데이터로 학습된 LLM을 활용하여 특정 분야에 특화된 챗봇을 만들 수 있습니다.

- 자동화된 텍스트 처리: 문서 요약, 보고서 초안 작성, 이메일 자동 응답 등 반복적인 텍스트 작업을 자동화할 수 있습니다.

- 창의적인 콘텐츠 생성: 소설, 시, 스크립트 등 다양한 형태의 창의적인 콘텐츠를 생성하는 도구로 활용할 수 있습니다.

- 코드 도우미: 개발 환경에 통합하여 코드 자동 완성, 오류 검출, 코드 설명 등의 기능을 제공할 수 있습니다.

이처럼 Ollama는 개발자들에게 로컬 AI를 활용한 무한한 가능성을 열어줍니다. 여러분의 아이디어를 현실로 만드는 데 Ollama 사용법이 큰 도움이 될 것입니다.

2. 개인 정보 보호와 AI의 민주화

Ollama는 AI 기술의 핵심 가치 중 하나인 ‘민주화’에 기여합니다. 고가의 클라우드 서비스에 의존하지 않고도 누구나 자신의 컴퓨터에서 최첨단 LLM을 활용할 수 있게 함으로써, AI 기술의 접근성을 크게 높입니다. 또한, 개인 정보 보호에 대한 우려 없이 AI를 활용할 수 있는 환경을 제공하여, 사용자들이 더욱 안심하고 AI를 일상에 통합할 수 있도록 돕습니다. 이는 AI가 소수의 거대 기업에 의해 독점되는 것을 막고, 더 많은 사람들에게 AI의 혜택을 돌려주는 중요한 발걸음입니다.

3. 향후 전망 및 기대: Ollama 사용법의 진화

Ollama는 빠르게 발전하고 있는 프로젝트입니다. 앞으로 다음과 같은 방향으로 더욱 진화할 것으로 기대됩니다.

- 더 많은 모델 지원: 더 다양한 오픈소스 LLM 모델들이 Ollama와 호환될 것이며, 특정 분야에 특화된 모델들도 늘어날 것입니다.

- 성능 최적화: 하드웨어 자원을 더욱 효율적으로 사용하여, 더 빠르고 안정적인 성능을 제공할 것입니다. 특히 Apple Silicon이나 NPU(Neural Processing Unit) 등 최신 하드웨어에 대한 최적화가 강화될 것으로 보입니다.

- 사용자 편의성 증대: 웹 UI나 데스크톱 애플리케이션 등 사용자 친화적인 인터페이스가 더욱 발전하여, 비전문가도 쉽게 Ollama를 활용할 수 있게 될 것입니다.

- 멀티모달 기능 통합: 텍스트뿐만 아니라 이미지, 오디오 등 다양한 형태의 데이터를 처리하는 멀티모달 LLM 기능이 통합될 가능성도 있습니다.

이러한 발전은 Ollama 사용법을 더욱 강력하고 다재다능하게 만들 것이며, 로컬 AI의 활용 범위를 상상 이상으로 확장할 것입니다.

Ollama 사용법은 단순히 기술적인 스킬을 넘어, AI 시대를 살아가는 우리에게 새로운 관점과 가능성을 제시합니다. 내 손안에서 펼쳐지는 AI의 마법을 직접 경험하고, 여러분만의 방식으로 AI를 활용하여 더 나은 미래를 만들어가는 여정에 동참해 보세요. 지금 바로 Ollama를 설치하고, 첫 LLM 모델을 실행해 보시길 강력히 추천합니다!